Eine Animation, die völlig lautlos abläuft, wirkt auf den Betrachter oft seltsam distanziert, beinahe geisterhaft. Das liegt nicht daran, dass die visuellen Elemente schlecht gestaltet wären, sondern daran, dass unser Gehirn darauf programmiert ist, visuelle Reize mit akustischen Signalen zu verknüpfen. Wenn wir sehen, wie zwei Objekte kollidieren, erwartet unser Verstand instinktiv ein Geräusch. Bleibt dieses aus, entsteht eine kognitive Dissonanz – das Gezeigte wirkt weniger glaubwürdig, weniger physisch und emotional flacher. Sounddesign ist im Motion Design daher das unsichtbare Gerüst, das den Bildern Gewicht, Textur und emotionale Tiefe verleiht. Man könnte sogar so weit gehen zu sagen, dass der Ton mindestens fünfzig Prozent des Gesamterlebnisses ausmacht. Er lenkt den Blick, kündigt Ereignisse an und definiert die Atmosphäre eines Stücks oft schneller, als es das Bild jemals könnte.

Dabei geht es nicht nur um das bloße Hinzufügen von Musik oder offensichtlichen Geräuschen. Professionelles Sounddesign arbeitet oft im Subtilen. Es sind die leisen Ambience-Sounds, das kaum wahrnehmbare Rauschen oder das präzise „Whoosh“ bei einer schnellen Kamerabewegung, die dem Zuschauer das Gefühl geben, sich in einem realen Raum zu befinden – selbst wenn dieser Raum abstrakt und grafisch ist. Wer Motion Design ernst nimmt, muss Audio als integralen Bestandteil des kreativen Prozesses begreifen und nicht als letzten Schritt kurz vor dem Export. Ein gut gestalteter Soundtrack kann eine mittelmäßige Animation aufwerten, während schlechter Ton selbst das brillanteste visuelle Meisterwerk ruinieren kann. Es ist eine Symbiose, bei der beide Elemente verschmelzen müssen, um eine überzeugende Geschichte zu erzählen.

Was dich hier erwartet

Das Wichtigste auf einen Blick

Sounddesign und Motion Design sind untrennbar miteinander verbunden. Während das visuelle Design die Informationen und die Ästhetik liefert, sorgt die Audioebene für die emotionale Bindung und die physische Glaubwürdigkeit der Szene. Ein durchdachtes Soundkonzept strukturiert die Animation zeitlich, lenkt die Aufmerksamkeit des Zuschauers gezielt auf wichtige Bildinhalte und etabliert eine Atmosphäre, die rein visuell nur schwer zu erreichen wäre. Dabei ist es entscheidend, Audio nicht als isolierten Arbeitsschritt am Ende der Produktion zu betrachten, sondern als parallelen kreativen Prozess, der das Timing und den Rhythmus der Animation maßgeblich beeinflusst. Wer die akustische Ebene vernachlässigt, verschenkt das halbe Potenzial seines Projekts. Die Integration von Sound erfordert technisches Verständnis für Frequenzen und Mischung, aber vor allem ein Gefühl für Timing und Dramaturgie.

- Sounddesign verleiht abstrakten Grafiken physisches Gewicht und Textur.

- Audio ist oft der primäre Träger von Emotionen in einem Motion-Design-Piece.

- Die akustische Ebene hilft dabei, den Blick des Zuschauers gezielt zu lenken.

- Rhythmus und Timing der Animation sollten eng mit der Musik und den Soundeffekten verknüpft sein.

- Ein Voiceover diktiert meist die Länge und das Pacing der Animation.

- Stille kann genauso wirkungsvoll sein wie Lärm, wenn sie als dynamisches Stilmittel eingesetzt wird.

- Technische Qualität bei der Abmischung ist essenziell, um amateurhafte Ergebnisse zu vermeiden.

Die Wirkung von Audio auf die visuelle Wahrnehmung

Es ist faszinierend zu beobachten, wie sehr ein und dasselbe visuelle Ereignis durch unterschiedliche Klänge in seiner Bedeutung verändert werden kann. In der Fachsprache nennt man das Phänomen, bei dem akustische und visuelle Reize zu einer neuen Wahrnehmungseinheit verschmelzen, Synchrese. Dieser Begriff beschreibt die spontane und unwiderstehliche mentale Verbindung zwischen einem visuellen Phänomen und einem gleichzeitigen akustischen Ereignis. Wenn ein animierter Kreis auf eine Linie trifft, entscheidet allein der Sound darüber, ob dieser Kreis ein schwerer Stein, ein weicher Gummiball oder eine zerbrechliche Glaskugel ist. Das Auge sieht nur die Form und die Bewegung, aber das Ohr liefert die Information über das Material und die Masse. Ohne den passenden Sound bleibt die Grafik abstrakt und emotionslos; erst der Klang verankert sie in einer für uns verständlichen Realität.

Diese psychoakustische Wirkung geht jedoch noch tiefer. Audio beeinflusst nicht nur die Interpretation von Materialität, sondern auch die Wahrnehmung von Geschwindigkeit und Dringlichkeit. Ein schnelles visuelles Objekt wirkt erst dann wirklich rasant, wenn es von einem passenden Doppler-Effekt oder einem dynamischen „Whoosh“ begleitet wird. Fehlt dieser akustische Hinweis, kann die Bewegung seltsam schwerelos oder langsam wirken, selbst wenn die Keyframes perfekt gesetzt sind. Das Gehirn sucht ständig nach Kausalität. Wird diese Erwartungshaltung durch passendes Sounddesign erfüllt, steigt die Immersion drastisch an. Wird sie enttäuscht, entsteht eine Distanz zum Gezeigten. Man kann also sagen: Das Sounddesign ist der „Klebstoff“, der die visuelle Illusion zusammenhält und glaubwürdig macht.

| Visuelles Ereignis | Sound-Wahl A (Wirkung) | Sound-Wahl B (Wirkung) |

|---|---|---|

| Ein Quadrat fällt schnell nach unten und stoppt abrupt. | Schwerer, dumpfer Aufprall (Beton/Stein): Das Quadrat wirkt massiv, schwer und gefährlich. | Helles „Boing“ oder Federn-Geräusch: Das Quadrat wirkt leicht, verspielt und harmlos. |

| Text fliegt buchstabenweise ins Bild. | Mechanisches Tippen (Schreibmaschine): Wirkt retro, analog und informativ. | Digitales Glitchen und Piepen: Wirkt futuristisch, technisch und datengetrieben. |

| Eine Kamerafahrt durch einen Tunnel. | Tiefes Grollen und Wind: Erzeugt ein Gefühl von Größe, Bedrohung und Weite. | Kein Sound oder nur leichte Musik: Die Bewegung wirkt rein grafisch und weniger räumlich. |

| Zwei Formen verschmelzen zu einer. | Organisches „Schmatzen“ oder Flüssigkeits-Sound: Wirkt biologisch, lebendig. | Elektrisches Summen und „Zap“: Wirkt technologisch, energetisch. |

| Ein Logo erscheint am Ende. | Halliger, epischer „Boom“: Das Logo wirkt monumental und bedeutend. | Kurzes, trockenes „Click“: Das Logo wirkt modern, effizient und präzise. |

Sound-Wahl A

Sound-Wahl B

Ein weiterer Aspekt der Wahrnehmung ist die emotionale Führung. Musik und Soundscapes setzen den emotionalen Kontext oft, bevor der Zuschauer den visuellen Inhalt überhaupt kognitiv verarbeitet hat. Ein düsteres Drone-Soundscape erzeugt Spannung, noch bevor eine Bedrohung im Bild sichtbar ist. Eine fröhliche Up-Tempo-Nummer signalisiert Leichtigkeit, selbst wenn die Bilder neutral sind. Im Motion Design wird dies oft genutzt, um komplexe oder trockene Themen – wie etwa Erklärvideos für Finanzprodukte – zugänglicher zu machen. Durch ein freundliches, warmes Sounddesign wird die visuelle Information als positiv und vertrauenswürdig „geframet“. Man manipuliert also im besten Sinne die Interpretation des Zuschauers durch die akustische Ebene. Wer dies meistert, kontrolliert nicht nur, was der Zuschauer sieht, sondern vor allem, wie er sich dabei fühlt.

SFX, Voiceover und Musik: Die drei Säulen einer starken Komposition

Ein professionelles Sounddesign gleicht einem gut gebauten Haus: Es braucht ein stabiles Fundament, tragende Wände und ein Dach, das alles schützt. Im Kontext von Motion Design sprechen wir hier von den drei Hauptkomponenten: Sound Effects (SFX), Voiceover (Sprache) und Musik. Jede dieser Säulen hat eine spezifische Funktion und darf nicht einfach willkürlich mit den anderen vermischt werden. Die Musik bildet meist den emotionalen Teppich; sie gibt das Tempo, die Stimmung und die Grundenergie vor. Sie ist das verbindende Element, das Szenen zusammenhält. Das Voiceover hingegen ist der Informationsträger Nummer eins. Es liefert den Kontext, erklärt Details und führt den Zuschauer narrativ durch das Stück. Hier ist Verständlichkeit das oberste Gebot. Die Sound Effects (SFX) schließlich sind das „Salz in der Suppe“. Sie akzentuieren Bewegungen, schaffen Realismus und sorgen für die nötige Dynamik.

Das Problem bei vielen Anfänger-Projekten ist, dass diese drei Ebenen oft gegeneinander kämpfen, anstatt sich zu ergänzen. Ein häufiges Szenario: Die Musik ist zu laut und drängt sich in den Vordergrund, während das Voiceover im Mix untergeht und die Soundeffekte alles zu einem undefinierten Brei verkleben. Ein gutes Mixing ist hier entscheidend. Man muss sich das wie ein Frequenzspektrum vorstellen. Die menschliche Stimme liegt meist in einem mittleren Frequenzbereich. Wenn die Musik in genau diesem Bereich ebenfalls sehr aktiv ist (z.B. durch E-Gitarren oder Synthesizer), kommt es zur sogenannten Frequenzmaskierung – die Sprache wird unverständlich. Hier gilt es, im Equalizer Platz zu schaffen oder die Musikwahl von vornherein so zu treffen, dass sie der Stimme Raum lässt. Es ist ein ständiges Ausbalancieren der Hierarchien.

- Ambience / Atmo: Der oft übersehene Hintergrundsound (z.B. Bürogeräusche, Wind, Raumhall), der verhindert, dass Stille als „toter Kanal“ wahrgenommen wird. Er schafft räumliche Tiefe.

- Hard FX: Konkrete Geräusche, die synchron zu einer sichtbaren Aktion passieren (Türknallen, Mausklick, Explosion). Sie müssen framegenau sitzen.

- Foley Sounds: Organische Geräusche wie Schritte, Kleiderascheln oder Handbewegungen, die oft nachträglich aufgenommen werden, um Charakteranimationen lebendiger zu machen.

- Abstract / Design SFX: Synthetische Klänge wie „Whooshes“, „Risers“ oder „Glitches“, die keine Entsprechung in der realen Welt haben, aber Bewegungen im Motion Design unterstreichen.

- Voiceover (VO): Die Erzählstimme. Sie sollte trocken (ohne Raumhall) aufgenommen und später passend zum visuellen Raum bearbeitet werden.

- Musical Score / Bed: Die musikalische Untermalung. Wichtig ist hier oft die Unterscheidung zwischen treibender Musik und atmosphärischen Klangteppichen.

Besonders interessant wird es, wenn man die Wechselwirkung zwischen diesen Ebenen kreativ nutzt. Man muss nicht immer alles gleichzeitig hören. In einem Moment hoher Konzentration oder Spannung kann es extrem wirkungsvoll sein, die Musik komplett auszublenden (ein sogenannter Drop-out) und nur noch das Atmen eines Charakters oder das Ticken einer Uhr zu hören. Solche dynamischen Wechsel schaffen Kontraste, die die Aufmerksamkeit des Zuschauers neu fokussieren. Auch das sogenannte Ducking ist eine essenzielle Technik: Dabei wird die Lautstärke der Musik automatisch oder manuell abgesenkt, sobald das Voiceover einsetzt. Das klingt technisch, ist aber für den Zuhörer ein ganz natürlicher Vorgang, der sicherstellt, dass die Botschaft ankommt. Die Kunst besteht darin, diese drei Säulen so zu arrangieren, dass sie wie ein einziges, organisches Ganzes wirken und nicht wie drei separate Spuren, die zufällig gleichzeitig abgespielt werden.

Wie du Bewegung und Klang perfekt synchronisierst

Im Motion Design ist das Timing der heilige Gral. Eine Animation kann noch so schön gerendert sein – wenn sie „off-beat“ ist oder die Bewegungen nicht zum Rhythmus passen, wirkt sie unrund und störend. Die Synchronisation von Bild und Ton erfordert ein fast musikalisches Verständnis von Bewegung. Ein klassischer Anfängerfehler ist es, Keyframes rein visuell zu setzen und dann zu hoffen, dass der Sound irgendwie passt. Profis arbeiten anders: Sie analysieren die Wellenform des Audios. Jeder Sound hat eine spezifische Struktur, meist bestehend aus Attack (dem Anschlag), Decay, Sustain und Release. Der visuelle „Impact“ einer Animation – also der Moment, in dem eine Bewegung ihren Höhepunkt erreicht oder eine Kollision stattfindet – muss exakt mit dem Transienten (dem lautesten, ersten Impuls) des Soundeffekts übereinstimmen.

Doch Synchronität bedeutet nicht immer, dass alles mathematisch exakt auf demselben Frame passieren muss. Manchmal wirkt es organischer, wenn der Sound ein oder zwei Frames *vor* dem visuellen Ereignis beginnt. Das nennt man im Filmschnitt J-Cut, und im Motion Design funktioniert das ähnlich, um eine Bewegung „anzukündigen“. Das Gehirn verarbeitet akustische Reize oft schneller als visuelle. Ein vorauseilender Sound bereitet die Wahrnehmung vor. Umgekehrt kann ein Sound, der minimal zu spät kommt, eine Bewegung schwerfällig und massig wirken lassen. Das Spiel mit diesen mikroskopischen Zeitversätzen ist das, was gutes Animation Timing von exzellentem unterscheidet. Es geht um das Gefühl, den „Groove“ der Animation zu finden.

Ein weiterer entscheidender Aspekt ist der Schnitt auf den Takt der Musik. Marker in der Timeline sind hier unverzichtbare Hilfsmittel. Wenn du eine Animation auf einen Musiktrack abstimmst, solltest du dir die Snare-Drums, Kicks und Hi-Hats sowie signifikante Melodiewechsel im Audio-Programm oder direkt in der Animationssoftware markieren. Diese Audio-Marker dienen als Ankerpunkte für deine Keyframes. Aber Vorsicht: Ein Schnitt oder eine Bewegung auf *jeden* einzelnen Beat kann schnell ermüdend und vorhersehbar wirken – das sogenannte „Mickey Mousing“. Viel eleganter ist es, den Rhythmus zu nutzen, aber auch mal bewusst Pausen zu lassen oder Bewegungen über den Takt hinausfließen zu lassen (Synkopen). Das schafft eine spannende Dynamik, die den Zuschauer bei der Stange hält, ohne ihn mit Reizen zu überfluten. Das Ziel ist ein harmonischer Fluss, bei dem Bild und Ton miteinander tanzen, anstatt nur parallel zu marschieren.

Merke

Perfektes Timing ist nicht immer mathematische Gleichzeitigkeit. Während harte Effekte (Hard FX) wie ein Aufprall meist framegenau sitzen müssen, profitieren atmosphärische Sounds oder Musikübergänge oft von einem leichten Versatz. Achte besonders auf die Beschleunigungskurven (Easing) deiner Animation. Ein Soundeffekt mit einem langsamen „Fade-In“ passt selten zu einer Animation, die abrupt und hart beginnt. Die visuelle Kurve im Graph Editor sollte idealerweise die Amplituden-Hüllkurve des Sounds widerspiegeln. Visuelles „Ease-In“ korrespondiert akustisch mit einem weichen Attack; ein harter visueller Stopp verlangt nach einem Sound mit kurzem Decay.

Die Workflow-Frage: Erst animieren oder erst vertonen?

Dies ist wohl die klassische „Henne-Ei-Frage“ im Motion Design. Sollte man zuerst die Animation fertigstellen und dann Sounds hinzufügen, oder erst das Sounddesign erstellen und darauf animieren? Die Antwort hängt stark von der Art des Projekts ab, aber in den meisten professionellen Produktionen, insbesondere bei erklärenden oder narrativen Formaten, hat sich ein „Audio-First“-Ansatz (zumindest teilweise) bewährt. Wenn ein Voiceover im Spiel ist, ist es fast unumgänglich, dieses zuerst aufzunehmen – oder zumindest ein vorläufiges „Layout-Voiceover“ zu verwenden. Die Länge des gesprochenen Textes diktiert unbarmherzig die Dauer der Szenen. Es ist extrem mühsam und ineffizient, eine fertig gerenderte Animation nachträglich zu strecken oder zu stauchen, nur weil der Sprecher den Satz langsamer betont als gedacht.

Bei rein musikalischen Projekten oder abstrakten Animationen ist es ebenfalls ratsam, den Musiktrack frühzeitig festzulegen. Die Musik gibt die BPM (Beats per Minute) und die dramaturgische Struktur vor. Wo ist der Höhepunkt? Wo ist die ruhige Passage? Wenn man diese Struktur kennt, kann man die visuellen Höhepunkte genau darauf abstimmen. Das spart unzählige Korrekturschleifen. Natürlich gibt es auch den umgekehrten Weg, bei dem ein Komponist die Musik exakt auf das fertige Bild schreibt (Scoring), aber das ist im typischen Motion-Design-Alltag oft aus Budget- oder Zeitgründen Luxus. Meistens arbeiten wir mit Stock-Musik oder bestehenden Tracks, an die wir uns visuell anpassen müssen.

Vorteile: Audio First (Erst Ton, dann Bild)

- Festes Timing: Voiceover und Musik geben eine klare zeitliche Struktur vor, was das Setzen von Keyframes erleichtert.

- Weniger Korrekturen: Man muss nicht nachträglich Animationen kürzen oder verlängern, um sie an den Ton anzupassen.

- Emotionaler Leitfaden: Die Stimmung der Musik inspiriert oft die visuelle Gestaltung und den Rhythmus der Bewegungen.

- Effizienter Schnitt: Man kann direkt auf den Beat schneiden („Cutting on beat“).

Nachteile: Audio First

- Eingeschränkte visuelle Freiheit: Man ist an die Länge des Audios gebunden und kann visuelle Ideen manchmal nicht voll ausspielen.

- Änderungen sind teuer: Wenn sich das Voiceover nachträglich ändert, muss oft die gesamte Animation angepasst werden.

- Gefahr der Starrheit: Man neigt dazu, zu sklavisch am Takt zu kleben, was die Animation mechanisch wirken lassen kann.

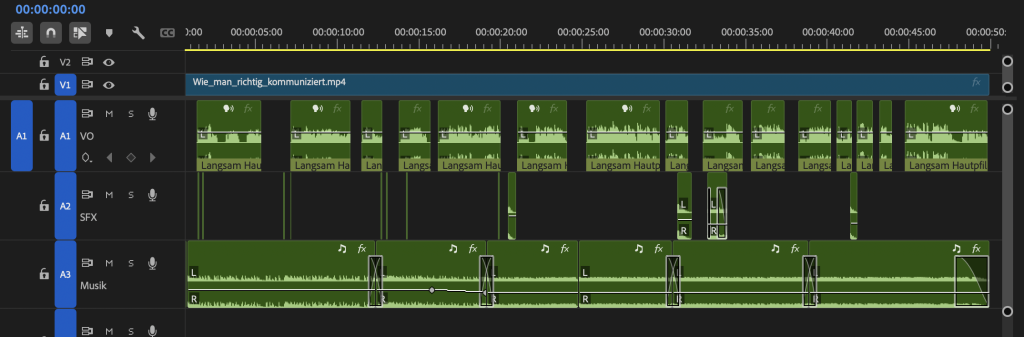

Ein hybrider Workflow ist oft die beste Lösung. Man beginnt mit einem sogenannten Animatic – einer groben Skizze der Animation – und legt darunter ein vorläufiges Audio (Scratch VO und Layout-Musik). In dieser Phase sind Änderungen noch schnell gemacht. Man schiebt Audio und Bild hin und her, bis der „Flow“ stimmt. Erst wenn dieses Grundgerüst steht, geht man in die Feinanimation und das finale Sounddesign. Das eigentliche Sounddesign – also das Hinzufügen von spezifischen Soundeffekten (SFX) wie Klicken, Rauschen oder Schritten – passiert meistens ganz am Ende, im sogenannten Post-Production-Prozess. Denn erst wenn die visuellen Bewegungen final sind, kann man die Sounds framegenau darauf platzieren. Würde man das zu früh machen, müsste man bei jeder kleinen Änderung an der Animationskurve auch den Soundeffekt neu verschieben. Effizienz ist hier das Schlüsselwort.

Häufige Fehler bei der Audio-Integration vermeiden

Selbst erfahrene Designer tappen immer wieder in Fallen, wenn es um die Audio-Integration geht. Einer der häufigsten Fehler ist die Verwendung von qualitativ minderwertigem Material. Ein schlecht aufgenommenes Voiceover mit Raumhall oder Rauschen lässt das gesamte Video sofort amateurhaft wirken, egal wie brillant die Grafik ist. Dasselbe gilt für billige Soundeffekte aus alten Bibliotheken, die jeder schon tausendmal gehört hat. Nichts reißt den Zuschauer schneller aus der Illusion als ein generischer, blecherner Sound. Ein weiteres Problem ist die fehlende Dynamik. Viele Anfänger neigen dazu, jeden freien Millimeter der Timeline mit Sound zuzukleistern. Das Ergebnis ist eine „Wall of Sound“, bei der alles gleich laut ist und nichts mehr hervorsticht. Das menschliche Ohr ermüdet schnell bei konstantem Lärmpegel. Mut zur Lücke – also bewusste Stille – ist oft wirkungsvoller als Dauerbeschallung.

Auch technische Aspekte werden oft vernachlässigt. Ein klassisches Beispiel ist das Clipping (Übersteuern). Wenn der Audiopegel die 0dB-Grenze überschreitet, entstehen hässliche digitale Verzerrungen. Das darf in einem professionellen Produkt niemals passieren. Umgekehrt ist ein zu leiser Mix problematisch, besonders wenn das Video auf mobilen Endgeräten konsumiert wird. Hier kommen Standards wie LUFS (Loudness Units relative to Full Scale) ins Spiel, die sicherstellen, dass die Lautheit den Plattformstandards (z.B. für YouTube oder TV) entspricht. Wer diese technischen Vorgaben ignoriert, riskiert, dass der Algorithmus der Plattform das Audio brutal komprimiert oder dass der Zuschauer ständig die Lautstärke nachregeln muss.

- Überladung (Over-designing): Zu viele Soundeffekte gleichzeitig machen den Mix matschig. Weniger ist oft mehr.

- Falsche Räumlichkeit: Ein Charakter, der weit weg steht, darf nicht klingen, als würde er direkt ins Ohr flüstern (fehlender Reverb/EQ).

- Schlechte Schnitte: Hörbare „Knackser“ an den Schnittstellen von Audioclips (fehlende Crossfades).

- Musik-Looping-Fehler: Wenn man hört, wo der Musiktrack endet und von vorne beginnt, bricht der Fluss.

- Ignorieren von Copyright: Die Verwendung von nicht lizenzierter Musik kann zu rechtlichen Problemen und Stummschaltung führen.

- Mono vs. Stereo vergessen: Wichtige Elemente wie Voiceover gehören meist in die Mitte (Mono/Center), während Ambience und Musik das Stereobild füllen sollten.

Ein weiterer, oft unterschätzter Fehler ist die fehlende Abstimmung zwischen visuellem Stil und Audio-Stil. Eine minimalistische, cleane 2D-Animation verträgt sich selten mit hyper-realistischen, schweren Soundeffekten. Hier wären synthetische, abstrakte Sounds passender. Umgekehrt wirkt eine fotorealistische 3D-Szene mit billigen 8-Bit-Sounds lächerlich (es sei denn, es ist als stilistischer Bruch gewollt). Die ästhetische Konsistenz muss gewahrt bleiben. Das bedeutet auch, dass alle Soundelemente aus dem gleichen „klanglichen Universum“ stammen sollten. Wenn die Musik warm und analog klingt, sollten die Soundeffekte nicht kalt und digital wirken. Ein abschließender „Mixdown“ oder ein Mastering-Prozess hilft dabei, alle Elemente klanglich zu verschmelzen („Glue“), sodass sie wie aus einem Guss wirken. Das ist der letzte Schliff, der den Unterschied macht.

Lass uns quatschen!